The Hidden Crisis of DRAM & NAND: AI Era Data Can't Stay Stored

I en tid av artificiell intelligens har vi länge fokuserat på datorkraft, kapacitet och hastighet.Vi lägger till mer DRAM, staplar HBM och utökar 3D NAND för att stödja större modeller och snabbare slutledning.Men en tyst, farlig kris håller på att växa fram: data kan inte längre lagras på ett tillförlitligt sätt.

Eftersom AI utvecklas från generativ AI till autonom Agentic AI, kräver system beständigt tillstånd, långtidsminne och kontinuerligt beslutsfattande.De kan inte längre tolerera tillfälliga eller instabila data.Samtidigt eroderar obeveklig skalning av DRAM och NAND för att uppnå högre densitet allvarligt datalagring och felmarginal.

Kärnutmaningen med lagring har förändrats: från "kan vi lagra det?"till "kan vi behålla det korrekt?"

Kärntrend: AI gör lagringssäkerhet kritisk

AI-system är inte längre enstaka datoruppgifter.Modern Agentic AI förlitar sig på:

- Långtidsminne

- Ihållande systemtillstånd

- Autonomt, kontinuerligt beslutsfattande

Detta innebär att lagring måste upprätthållas korrekta data över tid, inte bara arbeta under en kort period.Tillförlitlighet har blivit en fabrikat-eller-brytfaktor för stabiliteten i AI-infrastrukturen.

Grundorsak: Skalning sänker tillförlitligheten

Densitetsförbättringar skadar direkt stabiliteten.Detta är en oundviklig avvägning.

För NAND Flash

- Krympt XY-mått

- Ökade 3D-staplingslager

- Resultat: lägre felmarginal, lättare laddningsförlust

För DRAM

- Övergång till 3D DRAM

- Mindre cellstorlek

- Resultat: kortare uppehållstid, lägre ljudtolerans

Regel: Högre densitet = Lägre tillförlitlighet

NAND:s väsentliga problem: Laddningsförlust

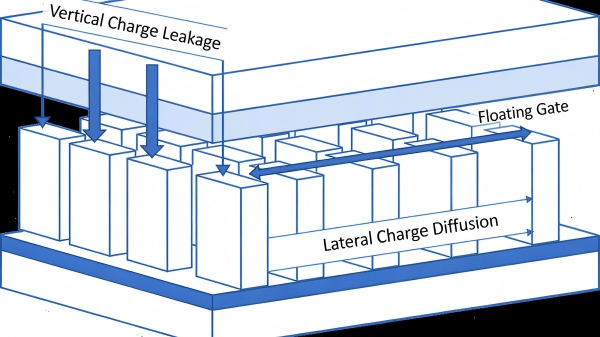

NAND-fel handlar om laddningsförlust, vilket sker på två huvudsakliga sätt:

- Vertikalt laddningsläckage – laddning kommer ut i kanalen

- Lateral laddningsdiffusion – laddning sprids mellan ordlinjer

Kortsiktigt vs långvarigt retentionsfel

- Kort sikt: Grunda fällor, initial voltage shift (IVS), förändringar dyker upp snabbt

- Långsiktigt: Djupa fällor, kombinerade mekanismer (TAT / DT / TE), problem blir mer komplexa med tiden

DRAMs dolda svaghet: Den kan inte "hålla" data heller

DRAM är inte säkert från retentionsfel.Den lider av flera läckagevägar:

- Kondensatorläckage

- Direkt tunnling

- Undertröskelläckage & GIDL

- Junction läckage

Det grundläggande skiftet i lagring

Tidigare: Lagring = kapacitet + hastighet, Fel fixade med ECC

Nu: Lagring = långsiktig tillförlitlighet + tillståndskonsistens, Lagring är grunden för systemstabilitet

Slutsats

Den verkliga krisen i AI-eran är inte otillräcklig datorkraft – det är det opålitlig datalagring.

När 3D NAND och DRAM skalas till mindre geometrier och högre densitet förvärras laddningsförlust och läckage.AI:s krav på beständigt minne förstärker dessa brister.

För att bygga stabila AI-system av företagsklass måste branschen flytta fokus från hastighet och kapacitet till retention, laddningskontroll och långsiktig tillförlitlighet.